UX, capitalismo de vigilância e a “banalidade do mal”

Não é novidade recente que estamos vivendo em uma era em que os objetos do cotidiano são inicializados, conectados e infundidos por algoritmos de todos os tipos, impulsionando nossa governança, estilo de vida e, mais importante, nossas interações sociais. O design de experiência de produtos digitais conecta sistemas interativos de alta qualidade às nossas vidas. No entanto, no back-end e por trás das cortinas de quase todos os produtos digitais de sucesso, nem os dados que eles capturam dos usuários, existem independentemente de ideias, preferências e capital, nem os algoritmos que eles usam para processar dados são compatíveis com nossos valores sociais como privacidade, autonomia ou equidade.

Há quase um ano,Mark HurstMark Hurst

Dirijo o Creative Good, escrevi “Customers Included”, criei o Good Todo e apresento o programa de rádio Techtonic na WFMU.

50 seguidoresSeguirescreveu um ensaio intitulado “ Por que estou perdendo a fé no UX ”. Em sua escrita, com a qual eu simpatizo extremamente, ele mantém a ideia de que os designers de UX mais talentosos e bem pagos são contratados por grandes empresas de tecnologia para se concentrar na exploração de usuários humanos, maximizando o tempo de tela e o engajamento, em vez de defender vulnerabilidades humanas ou mesmo resolvendo seus problemas diários ou da vida.

O UX mudou completamente agora, de defender o usuário a trabalhar ativamente contra os interesses dos usuários. Para aumentar os lucros, o UX se transformou em exploração do usuário.

Eventualmente, outros pensadores de UX responderam à sua escrita (“ Como colocar fé no design ”, “ Acordar do sonho de UX ”, “ O estado do UX ”, “ O UX significa experiência do usuário ou exploração do usuário? ”, etc. .). No entanto, ao contrário da primeira peça que é sustentada por vários casos (se não referências), outras mal atendem aos critérios de argumentos sólidos. Eles são, na melhor das hipóteses, opiniões pessoais de designers/pensadores de design experientes, sem documento de apoio claro, literatura de fundo ou referências acadêmicas/não acadêmicas.

Embora os argumentos de Hurst parecessem perfeitos e construídos com base em suas experiências vividas, senti que havia muita coisa que vale a pena mencionar para apoiar seu argumento. Embora eu acredite fortemente em seus argumentos, há um ponto em que não estou na mesma página com ele. Para mim, a seriedade da questão é mais do que o que ele revelou em seu ensaio. Acredito que a comunidade UX não está totalmente ciente do jogo latente por trás das atividades diárias de design e da quantidade de danos que nós, como designers, em nossos adoráveis sprints de design, com notas adesivas coloridas, estamos cozinhando para a humanidade. Aqui nesta história, tento preparar um resumo dos principais atores/geradores nas atuais preocupações ético-sociais do UX: o UX no qual acho que todos deveríamos estar perdendo a fé ou fazer algo sério sobre isso.

Dataveillance e a miragem dos dados brutos

Em primeiro lugar, como designers/pesquisadores de UX, nosso trabalho é considerado o principal motivo para coletar dados dos usuários. Porque queremos melhorar os produtos conhecendo mais sobre seus usuários. Em segundo lugar , isso parece não ter consequências indesejadas, desde que ninguém use mal os dados brutos. Capturamos o máximo que podemos , ao invés de querer com a ideia de que é melhor prevenir do que remediar!

No entanto, infelizmente, nenhum dos argumentos acima está certo! Considerar os dados (dados comportamentais humanos) uma matéria-prima de evidência ou um novo começo para tirar conclusões é em si uma presunção errada. Não há e não havia, tal coisa como dados brutos. Este conceito não é apenas ruim, mas enganoso. Os dados têm uma forte dependência da cultura e da sociedade. Mesmo a coleta inicial de dados já envolve intenções, suposições e escolhas que podem ser consideradas uma espécie de pré-processamento. Os dados não existem e esperam que sejamos descobertos, mas temos que gerá-los. No momento em que pretendemos gerá-lo, temos que imaginar sua contribuição funcional para nosso propósito, e essa imaginação envolve um certo grau de presunção. Coleta, gerenciamento, armazenamento e transmissão de dados estão entre as atividades que cozinham nossos dados de uma determinada maneira.

Meus próprios dados podem ter sido crus, mas quando comecei qualquer interpretação séria, eu os havia cozinhado muito bem. de “dados brutos” é oxímoro

Mas será que os designers e o aprimoramento de produtos são os principais motivos por trás da coleta de uma variedade de registros gerando com uma velocidade extremamente alta , resultando em um enorme volume de dados comportamentais sobre cada indivíduo?

Roger Clarke em 1986 cunhou o termo “ dataveillance ” para explicar “ o monitoramento sistemático, agregação e classificação de dados pessoais … de uma ou mais pessoas ” servindo à prática de controle sobre a sociedade. Você pode pensar “por que devo me preocupar se não faço nada de errado ?” E se eu lhe disser que em uma sociedade de vigilância como a maioria das nossas, a definição de errado é o locus da questão e está mudando ao longo do tempo. Há algo de errado em participar de uma marcha LGBTQ? Que tal uma manifestação política? Tendo problemas de saúde? Tem muitas dívidas? Ser mulher? ou Pertencente a uma determinada etnia? Existem tantas definições contraditórias de errado que, em algum momento, todos certamente estavam envolvidos em algo errado.

Conhecer os usuários com o objetivo de melhorar o produto é um teatro com designers de bonecos. A razão por trás de investir tanto na coleta de dados comportamentais é transformá-los em “produtos de previsão” dentro do contexto de uma sociedade de vigilância. Tenta-se prever o futuro da humanidade com base em dados preconceituosos, discriminativos e prescritivos capturados durante um show global de tecnologia, estrelando designers de UX em papéis de apoio essenciais.

Deuses Algorítmicos e Capitalismo de Vigilância

Inteligência artificial, aprendizado de máquina e modelagem preditiva tornaram-se deuses matemáticos inquestionáveis cujo sucesso, infelizmente, está em primeiro lugar e para a maioria em alinhamento com o lucro de empresas privadas ou para sustentar o estado-nação, mesmo que discriminem, desinformem ou atuem como ameaças vitais à nossa sociedades.

A este respeito, Cathey O’Neil apresenta Weapons of Math Destruction (WMD). Ela menciona como a nossa sociedade da informação criou deuses algorítmicos, com sua própria realidade de caixa preta que ninguém realmente pode apelar. Modelos matemáticos governam uma variedade de nossas interações sociais e governança. Por exemplo, com base na pesquisa do Facebook, as pessoas que foram expostas a menos conteúdo alegre produzem mais postagens negativas e vice-versa sem saber claramente o motivo de seu humor. Em outras palavras, o Facebook é capaz de afetar como milhões de pessoas se sentem, o que aprendem e se votam. Nossa emergente chamada “governança inteligente” também usa esses algoritmos cujos mecanismos são escondidos do público. Deixando a máfia saber apenas os resultados, esses algoritmos geralmente punem os pobres, culpam aqueles que estão cercados por criminosos, e discriminar nos processos de recrutamento. O’Neil melhor descreve as armas de destruição em massa no seguinte:

“Os aplicativos baseados em matemática que impulsionam a economia de dados foram baseados em escolhas feitas por seres humanos falíveis. Algumas dessas escolhas foram, sem dúvida, feitas com as melhores intenções. No entanto, muitos desses modelos codificaram preconceitos, mal-entendidos e preconceitos humanos nos sistemas de software que cada vez mais administravam nossas vidas. Como deuses, esses modelos matemáticos eram opacos, seu funcionamento invisível para todos, exceto para os mais altos sacerdotes em seu domínio: matemáticos e cientistas da computação. Seus veredictos, mesmo quando errados ou prejudiciais, eram indiscutíveis ou apelativos. E eles tendiam a punir os pobres e oprimidos em nossa sociedade, enquanto tornavam os ricos mais ricos.”

Poucas pessoas podem ver e trabalhar nos algoritmos das grandes empresas de tecnologia. Guilherme Chaslot, um ex-engenheiro do Youtube, com Ph.D. em ciência da computação foi uma daquelas pessoas que tem tentado repetidamente informar as pessoas sobre o fato de que os algoritmos de hoje não parecem estar otimizando o que é verdadeiro, equilibrado ou saudável para a democracia e outros valores sociais humanos.

Chaslot, elaborou que as plataformas de moderação de conteúdo de grande tecnologia estão criando realidades fictícias para a sociedade, utilizando algoritmos que trabalham para maximizar o engajamento, o tempo de tela e a atenção, em vez de relevância e verdade.

Assim, se “a terra é plana” mantiver os usuários online por mais tempo do que “a terra é redonda”, essa teoria será favorecida pelo algoritmo de recomendação.

Assim, se “a terra é plana” mantiver os usuários online por mais tempo do que “a terra é redonda”, essa teoria será favorecida pelo algoritmo de recomendação.

Enquanto estamos sendo constantemente monitorados, nas últimas duas décadas, nossos dados comportamentais humanos tornaram-se uma nova mercadoria para grandes empresas de internet serem meios para o mercado de outras empresas. Eles capturam experiências pessoais humanas e as processam por meio de modelos de aprendizado de máquina em caixa preta para criar “produtos de previsão” . Esses dados e insights sobre as atividades futuras das pessoas serão vendidos e servidos para ganho comercial de outros. Shoshana Zubof chama isso de nova era; “ a era do capitalismo de vigilância ”. Nesta era, o jogo das gigantes da internet é oferecer gratuitamente produtos digitais que resolvam os problemas das pessoas, enquanto no jogo das sombras, são os dados comportamentais das pessoas que pagam o custo.

Não somos “clientes” do capitalismo de vigilância. Embora o ditado nos diga “Se é grátis, então você é o produto ”, isso também está incorreto. Somos as fontes do excedente crucial do capitalismo de vigilância: os objetos de uma operação de extração de matéria-prima tecnologicamente avançada e cada vez mais inevitável. Os clientes reais do capitalismo de vigilância são as empresas que negociam em seus mercados para comportamento futuro.

Do centrado no ser humano para a exploração humana

Eu li muitos materiais de leitura sobre design centrado no ser humano, que acredito ser a essência de muitas das abordagens de design de produto/UX de hoje. Jo SzczepanskaJo Szczepanska

Jo quer viver em um mundo justo e saudável, onde os serviços são projetados em conjunto com as comunidades. É designer multidisciplinar com formação em pesquisa.

1,3 mil seguidoresSeguirA peça de ‘ Design thinking história de origem mais algumas das pessoas que fizeram tudo acontecer ‘ está de fato entre as melhores que dão uma compreensão geral do tema sem direção comercial para qualquer instituição. Se você revisar o HCD, entenderá como tudo começou a defender a natureza humana, resolver problemas humanos perversos e incluir vozes de usuários humanos no processo de design. Da tendência de Buckminster Fuller de usar equipes multidisciplinares para resolver problemas de habitação humana a designers escandinavos que incluíam o feedback dos trabalhadores na reorganização dos ambientes de trabalho, o HCD foi um novo conceito que enfatiza as necessidades dos usuários e não a intuição do designer.

Hoje, se você verificar as tendências das comunidades de design de UX, muitas vezes ouvirá frases como inclusivo, focado em equidade e acessibilidade como principais tendências de pesquisa de design de produto. Em alinhamento com isso, o Google fala sobre o próximo bilhão de usuários e o Facebook quer levar a internet para áreas altamente carentes . No entanto, lembrando da vigilância de dados , armas de destruição em massa e “ produtos de previsão ”, deveríamos estar dormindo tão profundamente se não pensássemos nisso como uma jogada que as grandes empresas de tecnologia estão orquestrando para esconder sua principal motivação. Em seu jogo de sombras, eles estão apenas em busca de mais e mais dados comportamentais; nem humanidade, nem acessibilidade, nem equidade!

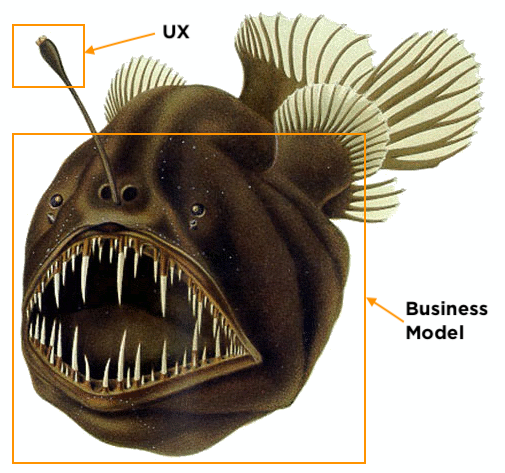

Por que as empresas gastariam bilhões para permitir que as pessoas mais pobres acessem seus produtos? Pelo mesmo motivo que fez com que o Google, o gigante da tecnologia com seu sistema operacional móvel líder (android), se concentre na produção dos smartphones mais baratos (Google Pixel)! Trata-se de “ mimetismo agressivo”, nome científico do fenômeno que costumamos chamar de “ lobo em pele de cordeiro” . O que eles querem são mais dados comportamentais e uma variedade de produtos de produção. Eles vendem essa ideia maligna por trás das bandeiras de design inclusivo, acessibilidade e movimentos focados em equidade e nós, designers, legitimamos suas intenções. Nós tecemos a “roupa de ovelha” que eles usam.

A UX geralmente incorpora metodologias prejudiciais e cegas ao valor enquanto é praticada. Quando as empresas testam várias alternativas de design A/B, não é a resolução de uma na solução de problemas humanos que a torna a escolha vencedora, é apenas a quantidade de engajamento que ela causa. Eles não nos mostram o que queremos (e precisamos), mas o que não podemos deixar de olhar, clicar e rolar.

UX também envolve alguns padrões de design antiéticos. Harry Brignullcriou o Projeto Padrões Escuros . Ele define dark patterns como “ truques usados em sites e aplicativos que fazem você fazer coisas que não queria, como comprar ou se inscrever em algo ”, coisas como a frustração em quase todo fluxo de cancelamento em quase todas as plataformas digitais. O fato irritante é que todos eles são cuidadosamente projetados por um designer ou equipe de UX servindo ao propósito de exploração humana de uma maneira completamente antiética.

A quantidade de danos que muitos produtos digitais estão trazendo para a sociedade humana é irreversível e, portanto, torna-se uma séria ameaça à humanidade. O livro de Harms é um projeto em andamento do Center for Humane Technology (CHT é o instituto por trás do documentário “Dilema Social”), criando uma lista bem citada de efeitos colaterais dos produtos digitais. Alguns são de tirar o fôlego:

66% é o aumento no risco de resultados relacionados ao suicídio entre meninas adolescentes que passam mais de 5 horas por dia (vs. 1 hora por dia) nas mídias sociais.

2 minutos de exposição a um vídeo de teoria da conspiração reduz as atitudes pró-sociais das pessoas (como sua disposição de ajudar os outros), além de reduzir sua crença em fatos científicos estabelecidos.

Quanto maior o seu nível de dependência do Facebook, menor o volume do seu cérebro. Exames de ressonância magnética do cérebro de usuários do Facebook demonstraram uma redução significativa na massa cinzenta na amígdala correlacionada com o nível de dependência do Facebook. Esta poda da matéria cerebral é semelhante ao tipo de morte celular observada em viciados em cocaína

A ignorância e o declínio da agência: “Eichmann em Jerusalém”

Muitos designers de UX dizem que apenas “damos às pessoas o que elas querem” para escapar de sua responsabilidade ética de manipular a natureza humana. Há também uma analogia de carpintaria ; dizendo que UX é apenas um conjunto de habilidades, como carpintaria; habilidades com zero agência e responsabilidade. Mas espere, se você fosse um carpinteiro, você faria uma mesa para qualquer pessoa, independentemente do seu propósito? Mesmo se você soubesse que a mesa servirá para torturar um prisioneiro?

Antes de preparar uma resposta, vamos relembrar um conceito contemporâneo expresso como “ banalidade do mal ” em um livro intitulado: “Eichmann em Jerusalém” de Hana Arendt. Adolph Eichmann era um agente nazista, responsável por organizar o transporte de milhões de judeus para vários campos em apoio ao propósito final dos nazistas (genocídio). Arendt, a filósofa e historiadora alemã, que era repórter do New York Times na época do julgamento de Eichmann, descreveu-o como alguém sem más intenções que agia sem outra motivação além de melhorar ansiosamente sua carreira no sistema nazista. Nas palavras dela, ele estava apenas seguindo as ordens sem questioná-las. Seu conceito de “Banalidade do Mal” remete à ideiaque atos malignos não são necessariamente perpetrados por pessoas más. Em vez disso, eles podem simplesmente ser o resultado de pessoas obedientes obedecendo a ordens.

Agora, considerando a banalidade do mal na analogia do carpinteiro, você ainda faria essa mesa independentemente de seu propósito final?

Esqueça “O que é Design?”, Atenha-se ao que não deveria ser!

Devemos todos perder a fé no UX? Fabrício Teixeira e Caio Braga, sob o sexto episódio de sua peça especial UX Collective para o início de 22 , também admitem que há algo errado com UX. Incentivar os designers a agir de acordo com essas preocupações na publicação de UX mais acessível é, de fato, um passo substancial. No entanto, ao pensar nessas preocupações, é importante não cair nos falsos argumentos e comparações clichês. Embora frases como “design não é filantropia”, “design é negócio” e “nosso trabalho não é salvar o mundo” sejam considerações muito apropriadas sobre design e designers, elas têm relevância limitada para essa discussão. Em muitas ocasiões, quando um diálogo sobre essas críticas ao UX está prestes a se formar, alguém começa a dizer “design é negócio” e “é lucrativo” como “vendas e marketing”.

Lembremos que essas frases não representam um argumento contraditório em resposta a críticas socioéticas de UX. Lembre-se na analogia do “lobo em pele de cordeiro”, o design é a roupa, o marketing não. Lembre-se que não ser filantropia não justifica a exploração humana. Lembre-se de que sempre há uma escolha entre lucro de longo prazo e lucro de curto prazo. Lembre-se, embora complicado, respeitar a natureza humana, assumir a responsabilidade por consequências não intencionais da plataforma e ficar do lado certo da história não contradiz os negócios ou o lucro. Lembre-se do Airbnb…!

Lembremos que essas frases não representam um argumento contraditório em resposta a críticas socioéticas de UX. Lembre-se na analogia do “lobo em pele de cordeiro”, o design é a roupa, o marketing não. Lembre-se que não ser filantropia não justifica a exploração humana. Lembre-se de que sempre há uma escolha entre lucro de longo prazo e lucro de curto prazo. Lembre-se, embora complicado, respeitar a natureza humana, assumir a responsabilidade por consequências não intencionais da plataforma e ficar do lado certo da história não contradiz os negócios ou o lucro. Lembre-se do Airbnb…!

Devemos todos perder a fé no UX? Heather Wiltse,escreve “ Capitalismo de Vigilância, por Design ”, quase um ano antes de “ Por que estou perdendo a fé em UX ”. Ela também, um pouco antes do tempo, questiona o papel do design de UX no estado atual da nossa sociedade da informação:

Qual é, então, o papel do design em relação aos edifícios e mecanismos completamente artificiais do capitalismo de vigilância? É reorganizar os pixels enquanto as possibilidades de outras formas de ordenar os sistemas econômicos e sociais ficam submersas, para nos manter como usuários distraídos enquanto nossas vidas são extraídas e suas sombras de dados vendidas pelo maior lance?…

Devemos todos perder a fé no UX? Harry Brignullsugere a criação de um código de ética para o design de UX/UI. Enquanto isso, ele parece ser um fã da humilhação pública daqueles que utilizam o que ele chama de padrões sombrios. Acredito que a combinação desses dois seja altamente complementar. Sem uma reação radical (humilhação pública), uma estratégia semi-legal gradual (códigos de ética) não chegará à prática profissional de UX.

Devemos todos perder a fé no UX? Tristan Harrise o Centro de Tecnologia Humana visam trazer temas semelhantes para o primeiro plano da sociedade (por exemplo, Dilema Social e Sua Atenção Indivisa ). No entanto, embora eu goste da abordagem aplicada do CHT, parece que eles não utilizam maturidade ou concentração suficiente quando se trata de design. Por exemplo, # oneClickSafer (sua petição para Mark Zuckerburg pedindo para remover o botão de re-compartilhamento das postagens após um certo número de compartilhamento), no meu entendimento, apesar dos valores humanos por trás, parecia uma solução de design ruim para o problema de desinformação.

Devemos todos perder a fé no UX? Eu não acho que seja uma boa ideia pular em qualquer receita para UX. Nem minha intenção ao escrever esta história era sugerir fazer uma ação. Em vez disso, eu pretendia dizer que há uma questão séria aqui que nós, como designers, temos que resolver: é crucial perceber que eles não são outros usando mal nosso design. A essência do nosso design está se tornando exploradora.

Separar a essência dos produtos de seu uso não é uma controvérsia nova. Marchal McLuhan, em seu ensaio marcante “ Medium is the message ”, responde ao argumento de David Sarnoff dizendo que “os produtos da ciência moderna não são em si bons ou maus; é a forma como são usados que determina o seu valor”:

Essa é a voz do sonambulismo atual. Suponha que disséssemos: “A torta de maçã em si não é boa nem ruim; é a maneira como é usado que determina seu valor.” Ou, “O vírus da varíola em si não é bom nem ruim; é a maneira como é usado que determina seu valor.” Mais uma vez: “As armas de fogo em si não são boas nem más; é a maneira como eles são usados que determina seu valor.” Isto é, se as balas chegarem às pessoas certas, as armas de fogo são boas. Se o tubo de TV disparar a munição certa nas pessoas certas, é bom. Não estou sendo perverso. Simplesmente não há nada na declaração de Sarnoff que possa ser examinado minuciosamente, pois ignora a natureza do meio…

Talvez se não utilizarmos tanto a crítica radical quanto o diálogo construtivo para emergir uma mudança gradual na abordagem, não possamos mais nos chamar de uma comunidade socialmente consciente. Ou temos que perder a fé no UX ou fazer algo sério sobre as preocupações socioéticas neste campo de prática. A autocrítica, o diálogo contínuo e a máxima conscientização podem esclarecer o tipo de posição que cada um de nós tomará sobre as preocupações no design de produtos digitais; aqueles que damos à luz.

Ilustração destacada: Ilustração baseada em uma foto de Adolf Eichmann em seu julgamento de 1961.

Fonte: UX Collective